فهرست مطلب

Toggleروز مهندس ۱۴۰۴ و کاربرد هوش مصنوعی در مهندسی

در حالی که بسیاری از مهندسان ایرانی هنوز درگیر ابزارهای خارجی فیلترشده، محدودیتهای دسترسی و روشهای سنتی زمانبر هستند، یک هوش مصنوعی کاملاً ایرانی و بومی دارد بیسروصدا انقلاب میکند و کارایی پروژهها، کدنویسی، طراحی، تحلیل و حتی تولید مستندات فنی را تا ۱۰ برابر سریعتر میکند.

روز مهندس ۱۴۰۴ دیگر فقط یک مناسبت نمادین نیست؛ روزی است که باید بپذیریم:

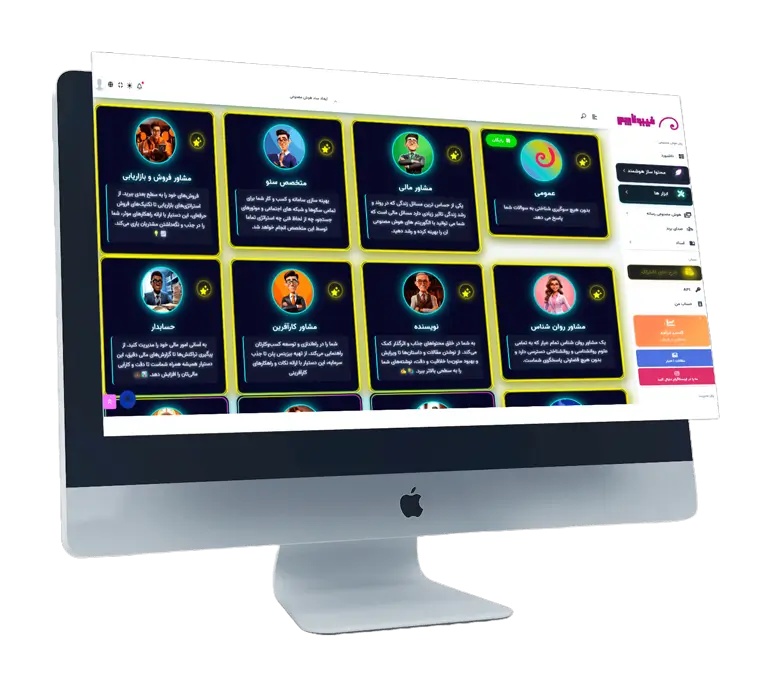

فیبوناچی دیگر یک چتبات معمولی نیست، بلکه یک دستیار هوشمند ایرانی است که با پشتیبانی کامل از زبان فارسی، مدلهای اختصاصی بومی و بیش از ۸۰ قالب تخصصی، مهندسان را از ساعتها کار تکراری خلاص میکند، پروژههای چندماهه را به چند هفته کاهش میدهد، هزینهها را به شدت پایین میآورد و به ایرانیها برتری رقابتی واقعی میدهد – بدون نگرانی از تحریم، فیلتر یا قطع API خارجی.

کاربردهای هوش مصنوعی در مهندسی

آمادهاید ببینید چطور این هوش مصنوعی ایرانی در سال ۱۴۰۴ مهندسی ایران را زیر و رو کرده و مهندسان هوشمند همین حالا از آن برای جلو زدن از رقبا استفاده میکنند؟

کاربرد هوش مصنوعی در مهندسی عمران و نقشهکشی:

کاربرد هوش مصنوعی در مهندسی برق:

کاربرد هوش مصنوعی در معماری:

کاربردهای هوش مصنوعی در مهندسی نرمافزار:

کاربرد هوش مصنوعی در مهندسی مکانیک و تأسیسات:

کاربرد هوش مصنوعی در مهندسی شیمی، نفت و پلیمر:

در صنایع حساس شیمی، نفت و پلیمر که کوچکترین خطا میتواند میلیونها دلار ضرر بزند یا ایمنی را به خطر بیندازد، فیبوناچی به مهندسان ایرانی کمک میکند تا مدیریت پروژههای عظیم پالایشگاه، واحدهای پلیمری و فرآیندهای شیمیایی را با اطمینان کامل انجام دهند. این پلتفرم بومی با تحلیل دادههای فرآیند، شرایط عملیاتی و مواد اولیه، برنامهریزی shutdownها و turnaroundها را بهینه میکند، زمانبندی دقیق مراحل کاتالیستریزی، تست و راهاندازی را تولید مینماید و ریسکهای ایمنی، زیستمحیطی و هزینهای را با دقت بسیار بالا پیشبینی میکند. گزارشهای فنی PID، PFD، HAZOP و ارزیابی ریسک کاملاً استاندارد و فارسی را در چند دقیقه آماده میکند، بهینهسازی مصرف کاتالیست و انرژی را پیشنهاد میدهد و حتی مستندات قراردادهای EPC را خودکار تولید مینماید. نتیجه؟ پروژه احداث یا بهینهسازی یک واحد پلیمر یا پتروشیمی که قبلاً ۲۴-۳۰ ماه زمان میبرد، حالا با فیبوناچی در ۸-۱۲ ماه به بهرهبرداری میرسد، هزینهها به شدت کاهش مییابد و مهندس شیمی ایرانی بدون وابستگی به نرمافزارهای خارجی گرانقیمت، برتری رقابتی واقعی پیدا میکند.

مهندس پرامپت هوش مصنوعی کیست؟

وظایف مهندس پرامپت

در تیمها، وظایف او فراتر از نوشتن پرامپت ساده است:

- طراحی System Promptهای اختصاصی برای کل محصول،

- ساخت زنجیرههای پرامپت چندمرحلهای (Prompt Chains)،

- ایجاد کتابخانههای پرامپت قابلاستفاده مجدد (Prompt Libraries)،

- اجرای A/B testing و ارزیابی متریکهای دقیق (مانند accuracy، relevance، hallucination rate، safety score)،

- نظارت بر عملکرد مدل در تولید (Production Monitoring)،

- شناسایی و رفع آسیبپذیریهای پرامپت (Prompt Injection، Jailbreak)،

- همکاری نزدیک با تیمهای محصول، توسعهدهندگان، متخصصان حوزه (Domain Experts)، تیم امنیت و حقوقی برای همراستاسازی خروجیها با سیاستهای شرکت،

- و حتی کمک به fine-tuning یا آموزش مدلها از طریق پرامپتهای آموزشی؛

کسی که بدون نوشتن حتی یک خط کد سنگین، با تسلط بر زبان، منطق، روانشناسی ماشین و کسبوکار، میتواند کل عملکرد یک سیستم هوش مصنوعی را ۵ تا ۱۰ برابر کارآمدتر کند و مستقیماً بر سودآوری، سرعت زمانبهبازار و مزیت رقابتی تأثیر بگذارد.

مهندسی داده در هوش مصنوعی

مهندسی داده در هوش مصنوعی (Data Engineering for AI یا به اختصار AI Data Engineering) یکی از حیاتیترین و پررونقترین نقشهای فنی در سال ۱۴۰۴-۱۴۰۵ است؛

مهندس داده در AI مسئول جمعآوری، پاکسازی، تبدیل و آمادهسازی دادههای عظیم و اغلب unstructured (متن، تصویر، ویدیو، صوت، tabular و time-series) است تا بهصورت باکیفیت، بهروز و governed به مدلهای AI تغذیه شوند؛ او خطوط لوله داده (data pipelines) را میسازد که latency پایین داشته باشند (برای inference real-time)، حجم دادههای عظیم را مدیریت کند (terabytes تا petabytes روزانه)، versioning داده و feature stores را پیادهسازی کند، data quality و lineage را تضمین کند تا hallucination و bias مدل کاهش یابد، و امنیت/حریم خصوصی دادهها را در سطح enterprise رعایت کند – همه اینها در حالی که با ابزارهای مدرن مثل Databricks، Snowflake، dbt، Apache Spark/Flink/Kafka، vector databases (Pinecone، Weaviate)، Lakehouse architectures و حتی AI-assisted tools (مانند dbt AI، Snowflake Cortex یا Gemini Code Assist) کار میکند.

وظایف مهندس داده در تیمهای AI

در تیمهای واقعی، وظایف یک مهندس داده در AI بسیار گستردهتر از نقش کلاسیک است:

- طراحی و ساخت data pipelines اختصاصی AI برای ingestion، preprocessing (chunking، embedding generation، deduplication، filtering noise)، enrichment و serving داده به مدلها

- مدیریت MLOps/LLMOps پایهای: data versioning، feature engineering خودکار، monitoring drift داده و مدل، CI/CD برای داده

- همکاری نزدیک با AI Engineers، ML Engineers، Prompt Engineers و Data Scientists برای درک نیازهای مدل (مثلاً حجم داده برای fine-tuning، کیفیت برای RAG، یا real-time برای agents)

- پیادهسازی governance و observability پیشرفته: data contracts، lineage tracking، access control برای جلوگیری از prompt injection یا data leakage در سیستمهای AI

- بهینهسازی هزینه (cost engineering) در cloud برای پردازش دادههای حجیم AI بدون هدررفت بودجه

- استفاده از خود AI برای اتوماسیون وظایف تکراری (نوشتن SQL/Spark با LLM، خودکارسازی transformationها، تشخیص anomaly در pipelines) تا زمان بیشتری برای طراحی سیستمهای استراتژیک داشته باشد.

در سال ۱۴۰۴، این نقش از یک پشتیبان فنی به یک enabler استراتژیک AI تبدیل شده؛ شرکتهایی که مدلهای generative یا agentهای هوشمند میسازند، بدون مهندس داده قوی در AI، عملاً نمیتوانند به تولید (production) قابل اعتماد برسند – چون ۸۰٪ موفقیت یک پروژه AI به کیفیت و دسترسیپذیری داده بستگی دارد، نه فقط به مدل.

نتیجه؟ تقاضای بسیار بالا برای این متخصصان (با حقوقهای رقابتی حتی در بازار ایران)، ترکیب مهارتهای سنتی مهندسی داده (SQL، Python، Spark، Airflow/Kafka، cloud) با دانش عمیق AI (درک LLMها، embeddings، RAG، fine-tuning needs، multimodal data handling) و توانایی فکر کردن در مقیاس سیستم (system thinking).

مهندس داده در AI کسی است که بدون او، هوش مصنوعی فقط یک ایده جذاب روی کاغذ میماند – اما با او، به یک محصول واقعی، مقیاسپذیر و سودآور تبدیل میشود. اگر در حال ورود به این حوزه هستید، تمرکز روی Lakehouse، vector search، data quality برای AI و ابزارهای AI-assisted pipeline را اولویت دهید؛

آینده مهندسی داده دقیقاً در تقاطع داده و هوش مصنوعی است.